KVキャッシュが推論コストを支配する理由——なぜ今この問題か

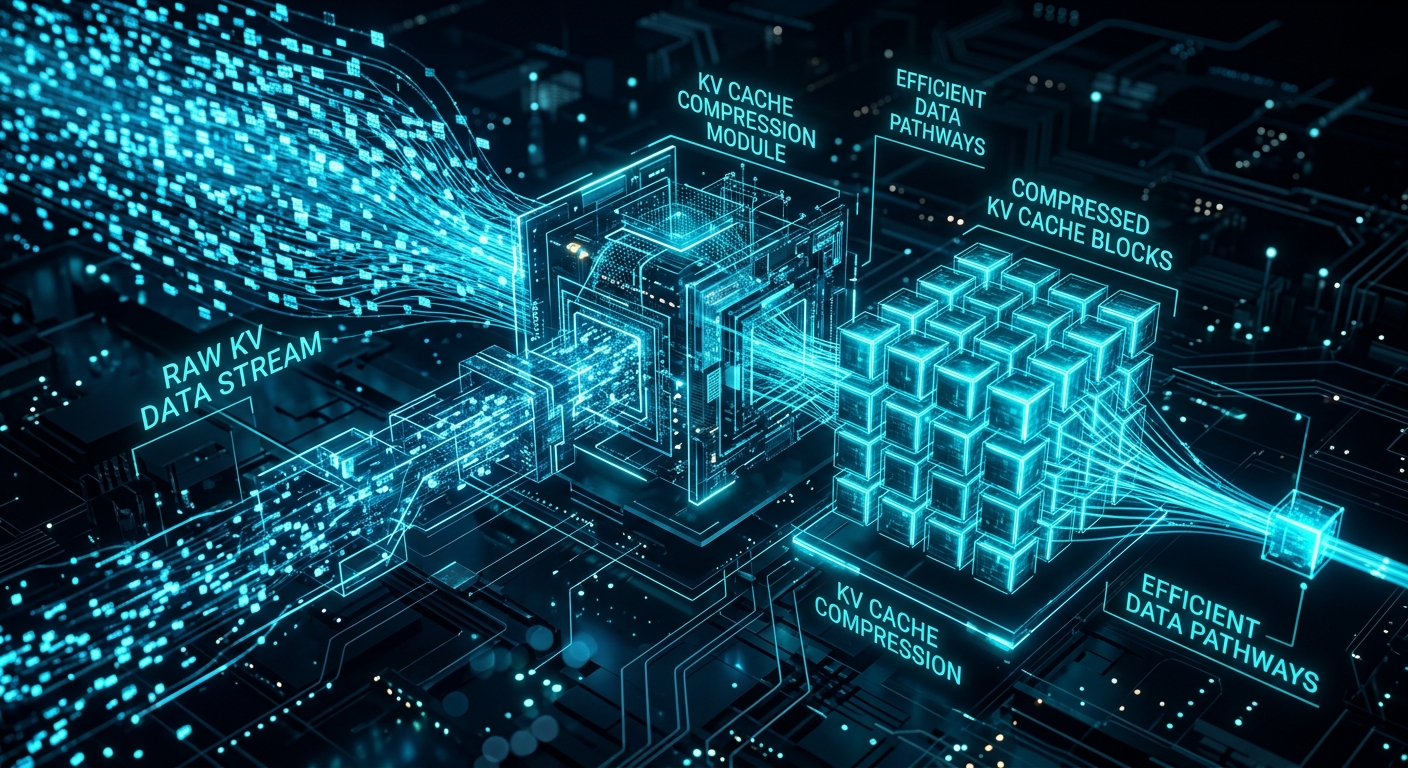

Transformerモデルの推論において、KVキャッシュ(Key-Valueキャッシュ)はメモリ消費の主要因だ。セルフアテンション機構は、各トークンを処理する際に過去の全トークンのキーとバリューを参照する。コンテキスト長が1万トークンを超えるような長文脈タスクでは、このキャッシュはGPUメモリの大部分を占有する。70Bパラメータのモデルを16ビット精度で動かす場合、KVキャッシュは数十GBに達することもある。

この問題に対する直感的な解決策が量子化——つまり、16ビット浮動小数点から4ビットや3ビットの整数表現に変換してメモリを削減することだ。ただし、KVキャッシュの量子化はモデルウェイトの量子化とは異なる難しさがある。キャッシュは推論の中間状態であり、バッチごとに異なる分布を持つ。GPTQやAWQのように事前キャリブレーションセットを用いた最適化が使えない。

Google ResearchがILCR 2026で発表したTurboQuantは、この制約の中でKVキャッシュを平均3.5ビットに圧縮する手法だ。再学習不要(Training-Free)で、16ビット精度と実質同等の性能を維持する。PolarQuantとQJLという2つの独立した変換を組み合わせることで、動的に生成されるキャッシュに対しても安定した量子化を実現した。

PolarQuant:極座標への変換で「不要な精度」を分離する

KVキャッシュを量子化する際の根本的な問題は、キーベクトルの各次元が非常に不均一な分布を持つ点にある。一部の次元は大きな値を持ち、アテンション計算に強く影響する。他の次元は小さな値でほとんど寄与しない。この不均一性を無視してすべての次元に均一なビット幅を割り当てると、重要な次元の精度が犠牲になる。

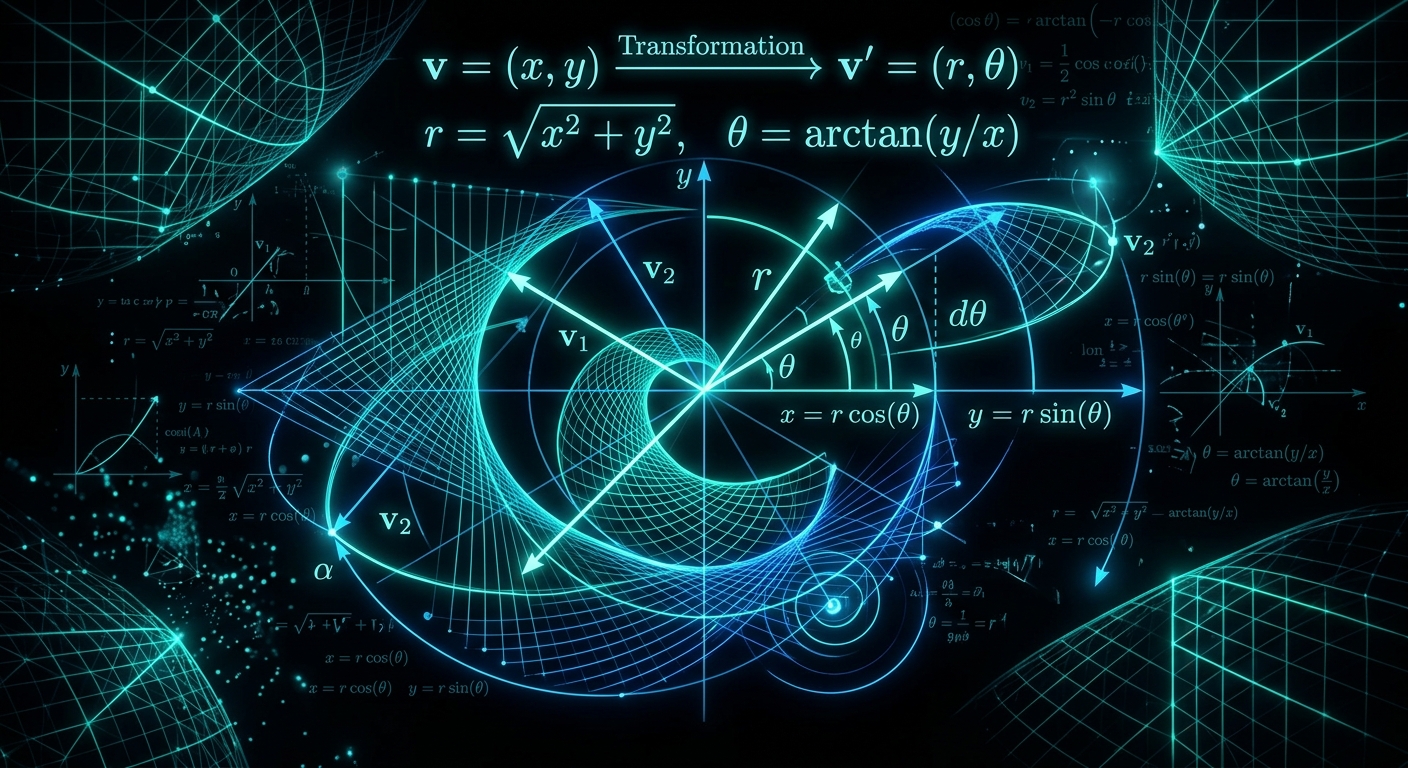

PolarQuantのアイデアはシンプルだ。キーベクトルをデカルト座標から極座標に変換する。2次元で言えばx,yをr,θに変換するのと同じ原理だが、これを高次元ベクトルの隣接次元ペアに対して繰り返し適用する。変換後、角度成分(θ)は高ビット精度で量子化し、半径成分(r)は低ビットで量子化する。直感的には、アテンションの向き(方向性)は精度が必要で、スケール(大きさ)は多少荒くても許容できるという考え方だ。

この変換の利点は2つある。第1に、極座標では情報の重要度が次元間で均等化される傾向があり、量子化誤差が特定の次元に集中しにくい。第2に、変換の逆操作(極座標→デカルト座標)は単純な三角関数であり、計算コストが軽量だ。TurboQuantはキーベクトルにPolarQuantを適用し、バリューベクトルには別のアプローチを用いる。

QJL:ランダム射影で量子化誤差を確率的に均質化する

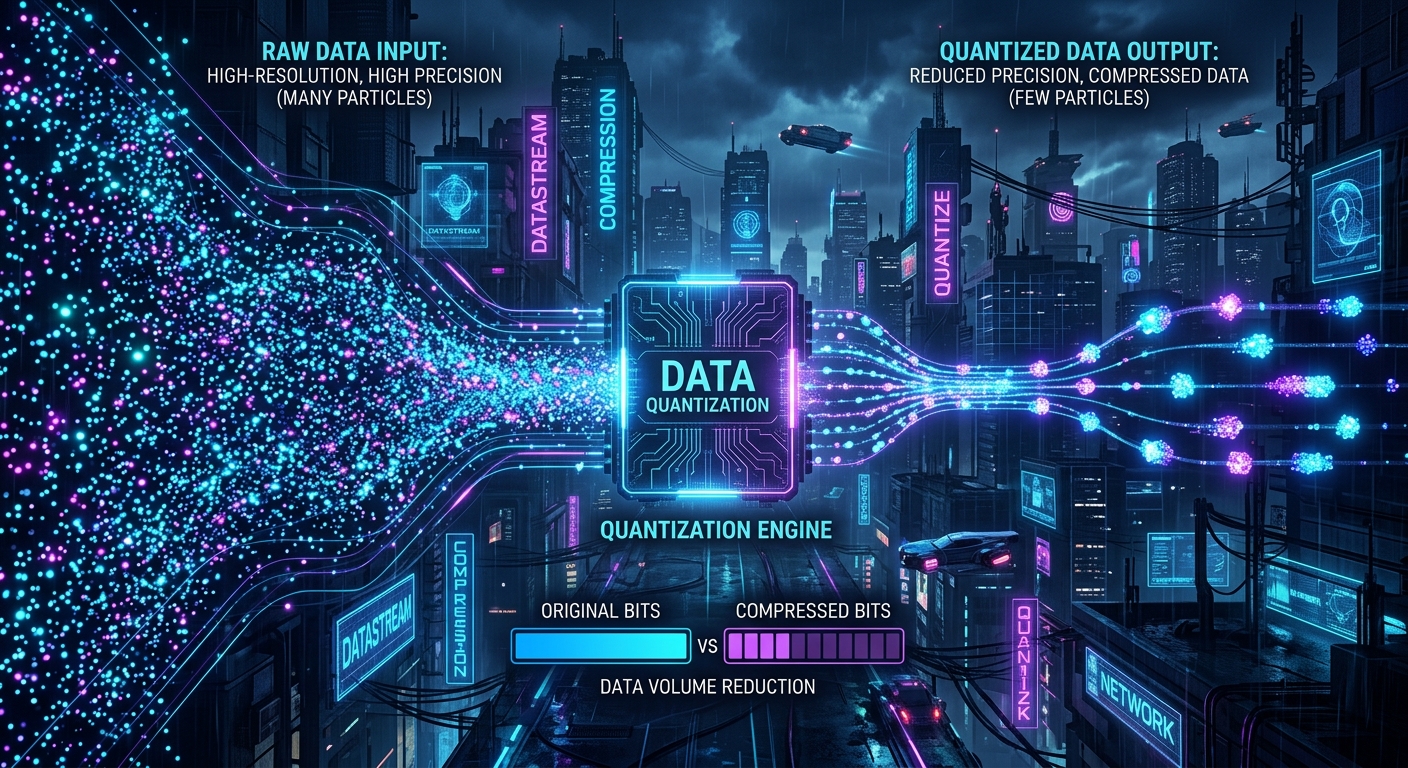

QJL(Quantized Johnson-Lindenstrauss Transform)はバリューベクトル側の圧縮手法だ。Johnson-Lindenstrauss補題は、高次元空間のベクトルに対してランダムな線形射影を適用しても、ベクトル間の距離関係が高い確率で保存されることを保証する数学的定理だ。QJLはこの性質を量子化に応用する。

バリューベクトルにランダム直交行列を掛けてから量子化する。このランダム変換によって、元の分布における「外れ値」——量子化誤差の主因——がランダムに各次元に分散される。特定の次元に大きな値が集中していても、変換後はその影響が均等化され、均一なビット幅でも全体の精度が維持されやすくなる。

重要なのは、このランダム行列は推論開始前に一度だけ生成してキャッシュすればよい点だ。バッチごとにキャリブレーションを実行する必要がない。キーへのPolarQuant、バリューへのQJL、それぞれの独立性がTraining-Freeの実現を支えている。

LongBenchとNeedle in a Haystackで証明された16ビット等価性

TurboQuantの有効性は、長文脈理解を中心としたベンチマーク群で検証された。LongBenchは要約、QA、コード補完など複数のサブタスクを含む長文脈評価セットであり、モデルが数千から数万トークンにわたる文脈を正確に参照できるかを測定する。Needle in a Haystack(NIAH)は長い文書の中に埋め込まれた特定の情報(「針」)を正確に取り出せるかを問うタスクで、KVキャッシュの量子化精度に特に敏感だ。

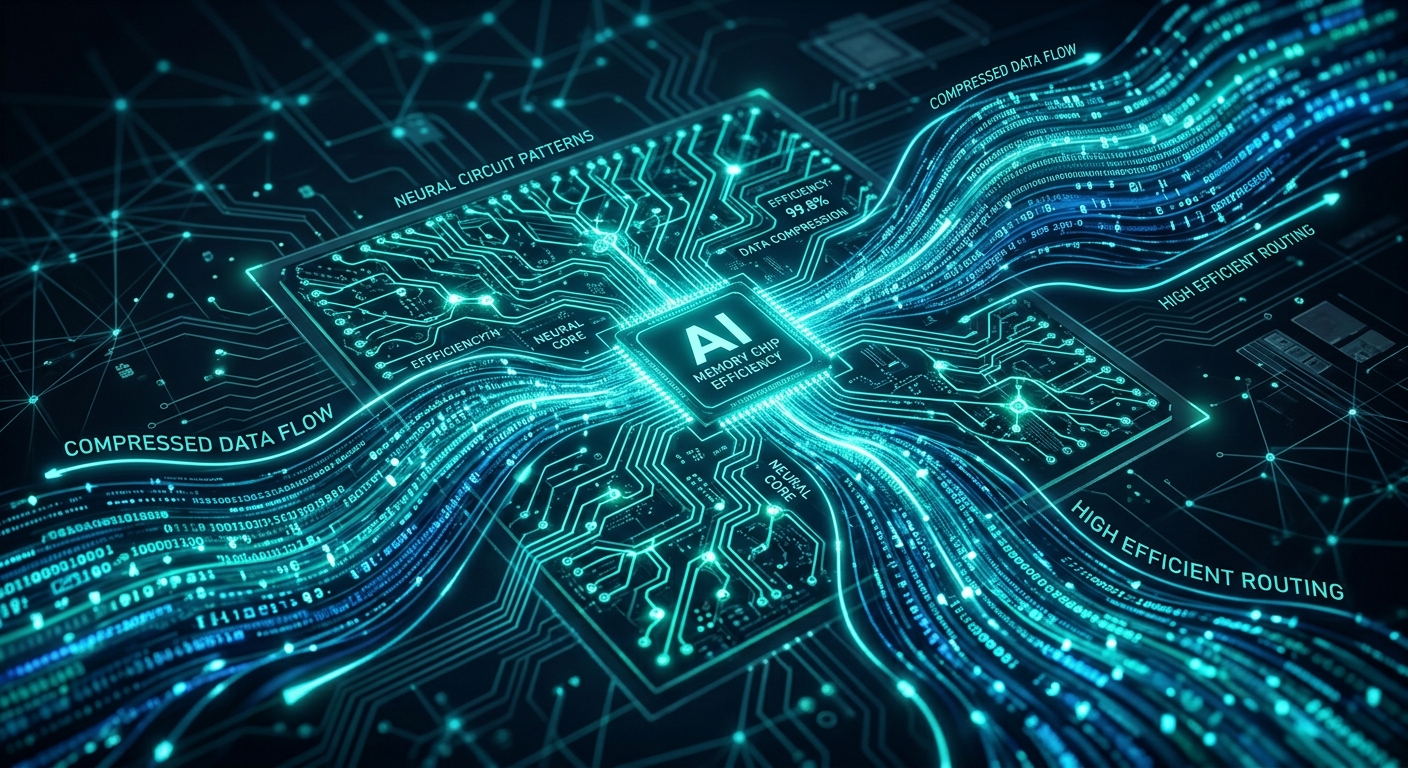

TurboQuantを適用したモデルは、これらのベンチマークでfull 16-bit精度と実質同等のスコアを記録した。3.5ビットという大幅な圧縮でも性能が維持されたことは、アテンション計算においてKVキャッシュの精密な値よりも相対的な構造(ベクトル間の角度関係)の方が重要であることを示唆している。

実用的なインパクトとして、TurboQuantを適用したLLMは同一GPUメモリ量でより長いコンテキストを処理できる。あるいは同じコンテキスト長での推論に必要なGPUメモリを大幅に削減できる。KVキャッシュはGPUメモリの主要な消費元であるため、この削減はバッチサイズの拡大にも直結する。AI推論に使われるHBMメモリへの需要が変化するとして、Micronや SK Hynixといったメモリチップ株への影響が金融市場でも議論された背景もここにある。

GPTQ・AWQとTurboQuant——量子化研究が解く問題の階層

TurboQuantを正確に位置づけるには、既存の量子化研究との関係を整理する必要がある。GPTQとAWQはモデルウェイトの量子化手法だ。GPTQは近似的な2次最適化でウェイトを量子化し、AWQはウェイトの重要度に応じてスケールを調整する。どちらも事前にキャリブレーションデータが必要で、モデルのデプロイ前に一度だけ実行する処理だ。

PrismMLのBonsaiシリーズが示した1-bit LLMはさらに極端なウェイト量子化の商用化事例だ。「ビット当たりの知能密度」という指標を提唱し、8Bモデルを1.15GBで動かすことを実現した。ウェイトを1ビットまで削減することで、デバイス上で動くモデルサイズの限界を引き下げる方向性だ。

TurboQuantが解く問題はウェイトではなくアクティベーション、より具体的には推論中に動的に生成されるKVキャッシュの量子化だ。これはGPTQやAWQが扱う問題と直交する。TurboQuantとGPTQを組み合わせれば、ウェイトもキャッシュも両方圧縮できる。MegaTrainがホストメモリ活用でトレーニング側のGPUメモリ制約を外したのと同様に、TurboQuantは推論側のメモリ制約を緩和するアプローチと見ることができる。トレーニングと推論、それぞれの効率化が並行して進んでいる。

より広い文脈では、S2D2(自己推測デコード)やHeiSDのような推論アルゴリズムの改善と、TurboQuantのようなキャッシュ圧縮は、同じ「推論効率化」という目標に対して補完的なアプローチだ。アルゴリズム層での高速化と、メモリ層での削減が組み合わさることで、長文脈LLMの実用コストが段階的に下がっていく構造が見えてくる。