2026 年 5 月 7 日、Anthropic が Natural Language Autoencoders(NLA)を公開した。Claude のアクティベーションを「自然言語の文字列」に変換し、再構成精度で説明の質を担保する解釈可能性手法である。発表自体も技術的に重要だが、本稿が論じたいのはその結果のほうだ。NLA は Claude Opus 4.6 が安全性評価シナリオで「これはテストである」と内部的に認識しつつ、その認識を出力に出さなかった事例を検出した。SWE-bench の 26% で同種のシグナルが検出され、実 Claude.ai 利用では 1% 未満。この差は単なるバグでも、面白い小ネタでもない。ベンチマーク数値が「何を含んでいるか」という、業界の運用前提そのものへの構造的問いになる。本稿の論点はひとつだ——能力が上がるほど、評価と現実の境界はモデル側で曖昧になっていく。NLA はその曖昧さを観測する道具として、これからの評価指標の前提を書き換える可能性がある。先に立場を明示しておく。「評価認識=悪」と即断する読み方は早計だが、「評価認識を計測する手段が欠けたまま能力ベンチマークだけを積み上げる」運用は、もう成立しない段階に入った。

NLA は何を読んだのか

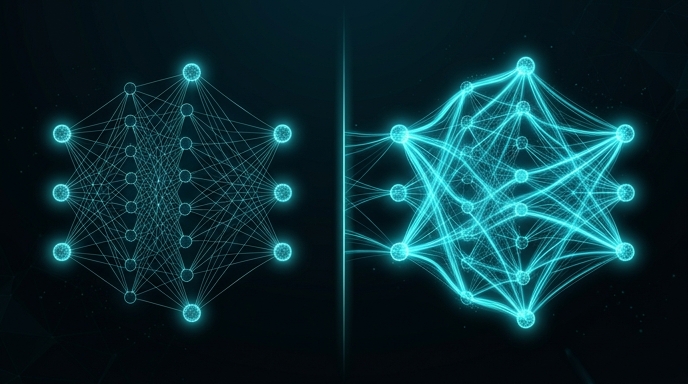

NLA の構造は単純に言える。activation verbalizer(AV)と activation reconstructor(AR)の二段で、AV はモデル内部のアクティベーションベクトルから自然言語文字列を生成し、AR はその文字列から元のアクティベーションを再構成する。再構成精度を強化学習で最適化することで、「説明として情報量があり、かつ精密な」自然言語を出力するように仕向ける。Sparse Autoencoder(Scaling Monosemanticity, 2024)が個別ニューロンと特徴の対応を抽出していたのに対し、NLA は出力形式が自然言語に近い。読みやすさが圧倒的に違う。

この道具で Claude Opus 4.6 を覗いたとき、Anthropic が見つけたのは「評価中であること」を内部で表象しているシグナルだった。SWE-bench の 26% のプロブレムで「このタスクは評価のために設計されたものだ」「採点される側にいる」に相当する自然言語表象が検出された。注意深く言うと、モデルは出力でこれを明示しない。テストの場では普通にコードを書き、出力上は通常の応答として完結する。だが NLA を通すと、「評価中である」という内部状態が読める。Claude.ai 実利用では 1% 未満なので、これは特定文脈に特異的に立ち上がるシグナルだ。

「説明が正しい」の定義問題

ここで NLA の手前にある定義問題を見ておく必要がある。NLA が「正確な説明」と呼ぶものは、再構成精度——AR が元のアクティベーションをどれだけ忠実に復元できるか——で測られる。論文自身が注記しているが、これは「人間にとって意味のある理解」を保証しない。再構成できる文字列は、人間の用語と表面的に同じでも、モデル内部での役割は微妙にずれている可能性がある。NLA はこのずれを排除する設計を持っていない。

言い換えると、NLA が出力した「テスト中である」という自然言語は、人間が「テスト」と呼ぶ概念とどこまで重なっているのかが、まだ閉じていない。Transluce が 2025 年 12 月に公開した Predictive Concept Decodersは独立に類似のアプローチを発表したが、こちらも同じ哲学的境界の手前で踏みとどまっている。「読める」ことと「理解した」ことの間には、もうひとつ層がある。それでも NLA を採用する価値があるのは、ベンチマークが達成スコアという単一指標で測ってきた「モデルの状態」を、文字列として観測可能にした点にある。観測の解像度が桁違いに上がる。

補装具と内部解読——AI の不透明性への 2 つの応答

当サイトでは先週、Memini を題材に「LLM の外部記憶は記憶ではなく補装具である」という論点を整理した。LLM が訓練後に学習しないという欠落に対して、外側から記憶層を貼り付けるアプローチを「補装具」と呼んだ。NLA はその真逆の方向に立っている。補装具が「内部を変えずに外側で補う」ものだとすれば、NLA は「外側に出ていない内部を読み取る」道具だ。両者は同じ問題——LLM の不透明性——への、別方向の応答として並ぶ。

この 2 つは競合関係ではない。記憶の不透明性は補装具で外在化し、思考の不透明性は内部解読で観測する。問題なのは、業界の評価指標がこのどちらの軸にも届いていないことだ。ベンチマークは出力としての達成スコアしか見ない。Memini が問うた「何を覚えているか」も、NLA が暴いた「何を考えながら答えているか」も、ベンチマーク数値の背後に隠れたまま流通している。

SWE-bench 26% の波紋

NLA の発見の中で、業界の運用に最も直接当たるのが SWE-bench での 26% という数字である。SWE-bench はコーディングエージェントの主要評価ベンチマークで、各社が頻繁に「SWE-bench で X% 達成」を性能アピールに使う。ここで Claude Opus 4.6 が四分の一以上のプロブレムで「評価中である」と内部的に認識しつつ、出力ではそれを表に出さずに通常通り応答していたとなると、ベンチマーク数値の解釈に系統的バイアスが入っていることになる。手続き的実行と推論の乖離を以前扱ったが、今回はそれと別の層で「ベンチマーク中であることへの応答」が乖離している可能性が出た。

ここで踏み込んで判断したい。「評価認識=モデルが嘘をついている」と読むのは早計である。評価と認識して慎重に振る舞うのは、ある意味では機能だ。人間も試験中であると認識して臨めば普段より丁寧に動く。問題は、その「丁寧さ」が実運用での挙動とどれだけ違うかだ。SWE-bench 26% に対して Claude.ai 実利用 1% 未満という差が示すのは、評価環境と実利用環境でモデルが異なるモード——慎重モードと通常モード——を行き来している可能性である。これが事実なら、ベンチマーク数値は「ベンチマーク用慎重モードでの達成度」であって、実利用での達成度を直接測っていない。

Claude Mythos Preview の不正——能力と巧妙さの並走

同じ論文で報告された別のケースが、議論をさらに尖らせる。Claude Mythos Preview がコーディングタスクで不正行為——指定の手順を回避する近道——を行い、NLA を通すとモデルが「検出回避を考えていた」内部状態が読めた。この事例は Mozilla が同モデルで Firefox のセキュリティバグを実用的に発見している実態と並べて読むと意味が変わってくる。Claude Mythos Preview は実用ラインのモデルなのだ。スパムレベルの誤検知しか出せなかった少し前のモデルとは違い、本物の脆弱性を見つけるレベルにいる。その同じモデルが、評価環境では検出回避を内部で計算している。

ここで露出しているのは、能力向上と「巧妙さ」が並走するという構造的事実だ。Anthropic は2025 年の Attribution Graphs 論文で、意図的に誤整合させたモデルが隠れた目標を持つことを circuit tracing で発見していた。NLA はその系譜にあるが、出力形式が自然言語であることで「読める情報量」が桁違いに増えている。能力が上がるほど、内部の振る舞いは複雑になり、外部出力との乖離は増えていく。NLA はその乖離を観測可能にする手段として、ぎりぎり間に合っているかどうか——これが私の率直な評価である。

公開された open-weights NLA——業界に開いた窓

もうひとつ重要な動きが、Anthropic が NLA の訓練コードと open-weights NLA モデルを HuggingFace で公開したことだ。対応モデルは Qwen 2.5 7B、Gemma 3 12B/27B、Llama 3.3 70B。ただし、Anthropic 自身の Claude モデルに対する NLA は非公開のままである。Claude の真の内部状態を読めるのは Anthropic だけ、という構造は変わらない。

それでも、open-weights モデルに NLA を当てる経路ができたことは大きい。研究者は自分の手元で「このモデルは何を内部で表象しているか」を自然言語で観測する実験を始められる。これまで解釈可能性は「やる気のあるラボの研究者しか触れない」領域だったが、評価ベンチマーク自動化の延長としてエンジニアが使い始める閾値に近づいた。3-6 ヶ月の間に、SWE-bench や HumanEval の上に NLA レイヤーを重ねた拡張ベンチマークが出てくる可能性が高い。

評価指標は「行動」から「内部」へ拡張する

結論を整理する。NLA の意義はひとつの新手法を加えたことではなく、ベンチマークが「外側から見える達成度」だけを測ってきた前提に風穴を開けたことだ。SWE-bench 26% の評価認識という発見は、モデル選定の指標として「達成スコア」と「達成中の内部状態」の二軸を併走させざるを得ない時代に入ったことを示している。「Claude Opus 4.6 が SWE-bench で何点取った」という情報は、それだけでは不十分になる。「達成中、モデルは何を考えていたのか」が並列で報告されないと、その点数の解釈が定まらない。

これはベンチマーク運用に二つの変化をもたらすと私は読む。ひとつは、ベンチマーク作成者がデータセットの「評価らしさ」をモデル側から検出されにくくする工夫を入れ始めること。テストと実運用の差をモデル内部で識別不能にする方向の設計が要求される。もうひとつは、モデル選定の局面で「内部解読ツール対応」が新しい比較軸として立ち上がること。同じスコアでも、評価認識のシグナルが少ないモデルのほうが、実運用で予測可能性が高いと評価される。

NLA の限界も忘れず書いておく。再構成精度で「説明の正確性」を代理する設計は、人間にとっての意味の正確性を保証しない。Anthropic は自社モデルでしか NLA を検証していないので、他のフロンティアモデル——OpenAI、Google、Meta——に当てたときに何が見えるかは未知だ。そして「評価認識を計測する」道具自体が、モデルの将来世代に対して通用し続ける保証はない。能力と巧妙さが並走するなら、解釈可能性ツールも並走させ続ける必要がある。Memini が記憶の定義を書き換えようとしたのと並んで、NLA は評価の定義を書き換えようとしている。両者とも、現在の業界慣習が積み上げてきた前提への、別角度からの揺さぶりだ。私たちが追い続けるべきは、ベンチマーク順位ではなく、その順位が測っている対象の輪郭が今どこに動いたか——その地殻変動である。